Hadoop與Spark 大數據時代的處理與存儲雙引擎

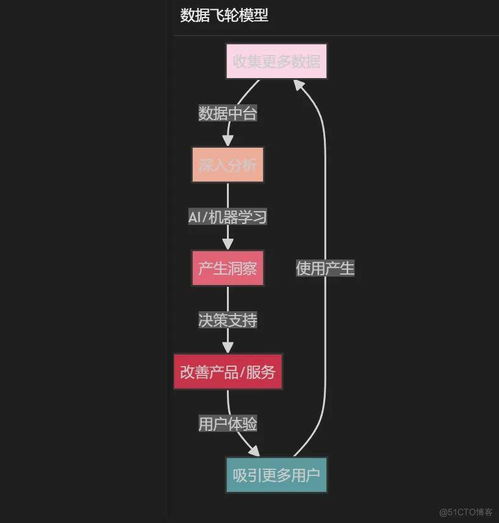

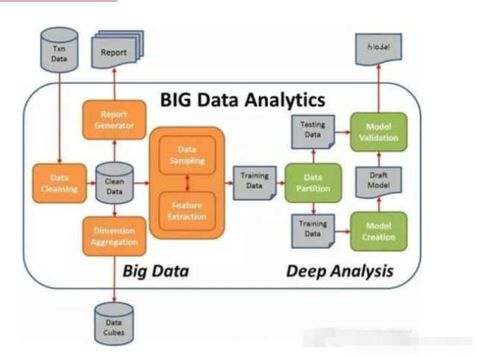

在大數據時代,高效的數據處理與存儲技術是企業挖掘數據價值的關鍵。Hadoop和Spark是這一領域中最為核心和廣泛應用的兩個開源框架,它們共同構成了現代大數據生態系統的基石,為企業提供了強大的數據處理和存儲支持服務。

一、Hadoop:分布式存儲與批處理的奠基者

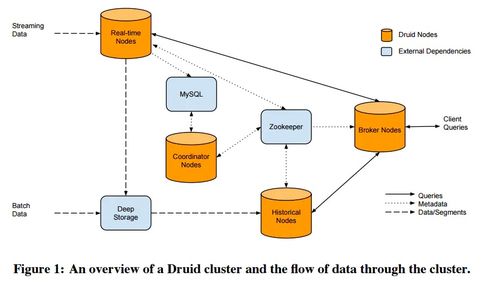

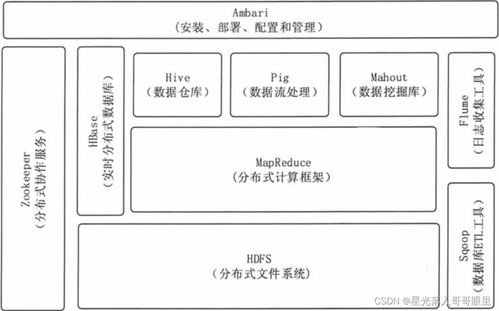

Hadoop是一個由Apache軟件基金會開發的分布式系統基礎架構,其核心設計目標是能夠以可靠、可擴展的方式存儲和處理海量數據(從GB到PB級別)。它主要解決了兩個根本問題:海量數據的存儲和大規模數據的批處理計算。

- 核心組件與存儲支持:

- HDFS (Hadoop Distributed File System):這是Hadoop的存儲基石。它將大文件分割成多個數據塊(默認為128MB或256MB),并分布式地存儲在一個由普通商用服務器組成的集群中。HDFS具有高容錯性,通過多副本機制(默認3副本)確保數據安全,即使部分節點失效,數據也不會丟失。它提供了高吞吐量的數據訪問能力,非常適合一次寫入、多次讀取的場景,如日志文件、歷史數據存檔等。

- MapReduce:這是Hadoop最初的計算引擎。它是一種編程模型,用于并行處理大規模數據集。計算任務被分為兩個階段:

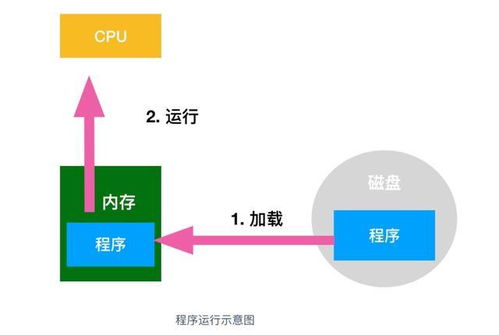

Map(映射)和Reduce(歸約)。Map階段將任務并行化處理,生成中間鍵值對;Reduce階段則對中間結果進行匯總。雖然它非常強大且穩定,但其基于磁盤的I/O操作模式在迭代計算(如機器學習)和交互式查詢場景下效率較低。

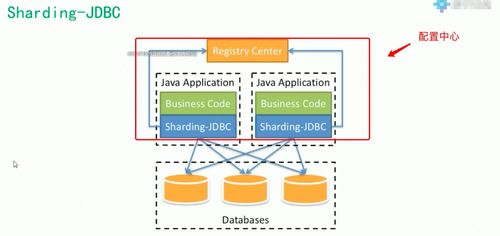

- YARN (Yet Another Resource Negotiator):作為Hadoop 2.0引入的資源管理平臺,YARN將資源管理與作業調度/監控功能分離。它負責集群資源(CPU、內存)的統一管理和調度,允許在Hadoop上運行多種計算框架(如MapReduce、Spark、Tez等),使Hadoop從一個單一的計算系統進化成為一個通用的數據操作系統。

Hadoop的服務定位:Hadoop本質上提供了一個低成本、高可靠、可線性擴展的分布式數據湖存儲方案(HDFS) 和一個通用資源管理平臺(YARN)。其原生的MapReduce引擎是強大的批處理工具,但如今更多作為存儲和資源底座,支持上層更高效的計算引擎。

二、Spark:高速內存計算的革新者

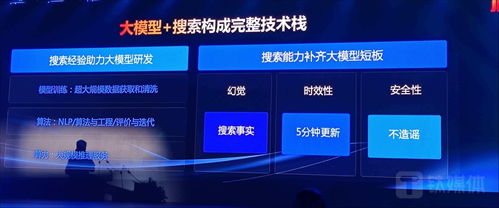

Apache Spark是一個專為大規模數據處理而設計的快速、通用、可擴展的計算引擎。它最初是為了彌補MapReduce在迭代和交互式計算上的性能瓶頸而誕生的。Spark的核心優勢在于其基于內存的計算。

- 核心特性與處理能力:

- 速度:Spark通過將中間數據緩存到內存中,減少了大量磁盤I/O,使得其在迭代算法(機器學習)和交互式數據查詢上的性能比基于磁盤的MapReduce快數十倍甚至上百倍。

- 易用性:Spark提供了豐富的高級API(支持Scala、Java、Python和R),并引入了易于理解的抽象概念,如彈性分布式數據集(RDD) 以及更高級的DataFrame和Dataset,讓開發者能夠像操作本地集合一樣編寫分布式程序。

- 通用性:Spark設計了一個統一的引擎,支持多種工作負載。其核心庫包括:

- Spark SQL:用于處理結構化數據的模塊,支持使用SQL或DataFrame API進行查詢。

- Spark Streaming:用于處理實時流數據(微批處理)。

- MLlib:可擴展的機器學習庫。

- GraphX:圖計算庫。

- Structured Streaming:基于Spark SQL引擎構建的、更先進的流處理模型。

Spark的服務定位:Spark本身不提供原生的分布式存儲系統。它是一個純粹的計算引擎,其數據處理能力需要建立在存儲系統之上。它最常與HDFS結合使用,從HDFS讀取數據,在內存中高速處理,再將結果寫回HDFS或其他存儲系統(如HBase、S3等)。它可以在YARN上運行,由YARN為其分配和管理資源。

三、協同共生:數據處理與存儲的完美搭配

在實踐中,Hadoop和Spark并非互斥的替代品,而是互補的伙伴,形成了經典的“Hadoop+Spark”架構。

- Hadoop提供“地基”:HDFS提供海量、廉價、可靠的存儲;YARN提供穩定的資源池管理和多租戶支持。

- Spark提供“引擎”:作為運行在YARN之上的一個高效計算框架,它從HDFS中讀取數據,利用內存進行高速計算,完成復雜的批處理、流處理、機器學習等任務。

類比理解:可以想象一個大型圖書館(Hadoop)。HDFS是圖書館的書架和書庫,負責安全地存放所有書籍(數據)。YARN是圖書館的管理員,負責協調誰(哪個計算任務)可以在什么時候使用哪個閱覽室(計算資源)。而Spark則是一位極其高效、博學的研究員(計算引擎),他從書庫(HDFS)借出大批書籍,在自己的高速思維(內存)中進行分析、關聯和,最終產出研究報告(處理結果)。MapReduce則是另一位嚴謹但速度較慢的研究員,他需要頻繁地在書架和書桌間往返(磁盤I/O)。

###

- Hadoop的核心價值在于分布式存儲(HDFS) 和資源調度(YARN),其原生計算引擎MapReduce適合超大規模、對延遲不敏感的離線批處理作業。

- Spark的核心價值在于基于內存的高速、通用計算引擎,它極大地提升了數據處理的性能,特別適合迭代計算、交互式查詢和實時流處理。

- 兩者關系:在現代大數據架構中,Hadoop(尤其是HDFS和YARN)常常作為Spark的存儲和資源管理底座。Spark憑借其卓越的性能和易用性,已成為大數據處理領域事實上的標準計算引擎。它們共同為企業提供了從海量數據存儲到高效數據分析的全棧式支持服務,驅動著數據驅動型決策和智能應用的發展。

如若轉載,請注明出處:http://www.tgcolor.cn/product/33.html

更新時間:2026-02-24 17:05:42